Entscheidungen treffen oder sterben — was bleibt, wenn KI entscheidet

Letzte Woche saß ich in einer Priorisierungsrunde. Vierundvierzig Features, alle mit «High». Ein PO, der die Stirn in Falten legte. Niemand sagte Nein. Alle nickten, alle lächelten.

Priorisierung oder Chaos

Letzte Woche saß ich in einer Priorisierungsrunde. Vierundvierzig Features, alle mit «High». Ein PO, der die Stirn in Falten legte. Niemand sagte Nein. Alle nickten, alle lächelten.

Das ist der Moment, in dem eine Organisation stirbt. Nicht weil die Features schlecht waren, sondern weil Nein ein Wort geworden ist, das hier niemand spricht. Niemand will Verantwortung tragen. Niemand will sagen: «Das machen wir nicht.» Denn Nein bedeutet Konsequenzen. Nein bedeutet, dass irgendwer böse wird. Und böse werden ist schlecht für Status, für Karriere, für Zugehörigkeit.

Also sammelt man Features. Man plant. Man priorisiert in endlosen Abstimmungsrunden. Und irgendwann stellt man fest: Das Team schafft zwei Features die Woche. Es gibt vierundvierzig. Mathematik ist brutal.

2008 schrieb ich auf meinem Blog: «Was sind die wahren Gründe, nicht fokussiert zu sein, sondern ständig etwas anderes zu tun? Zu viele Projekte gleichzeitig durchzuführen, anstatt einfach zu verstehen, dass es eben nicht schneller geht?» Das war die zentrale Frage damals. Sie ist es heute noch. Die meisten Organisationen leiden nicht an Informationsmangel. Sie leiden an Entscheidungsangst.

Die Lüge von der Information

Die ganze Welt läuft den Daten hinterher. «Wenn wir nur genug Daten hätten, dann könnten wir richtig entscheiden.» Analysen. Dashboards. Business Intelligence. KPIs. Jedes Jahr bessere Tools, bessere Daten, bessere Algorithmen. Und doch entscheidet niemand.

Ein Unternehmen, das nicht richtig priorisiert, verliert mindestens zwanzig Prozent seines Umsatzes — das ist keine Theorie, das ist eine Beobachtung aus hunderten von Teams. Sutherland hat das später wissenschaftlich bestätigt. Die Zahlen sind über die Jahre stabil geblieben. Nicht weil die Informationen schlechter geworden wären. Sondern weil Priorisierung nicht mit Information zu tun hat. Sie hat mit Entscheidung zu tun. Und Entscheidung ist etwas, das Menschen fürchten.

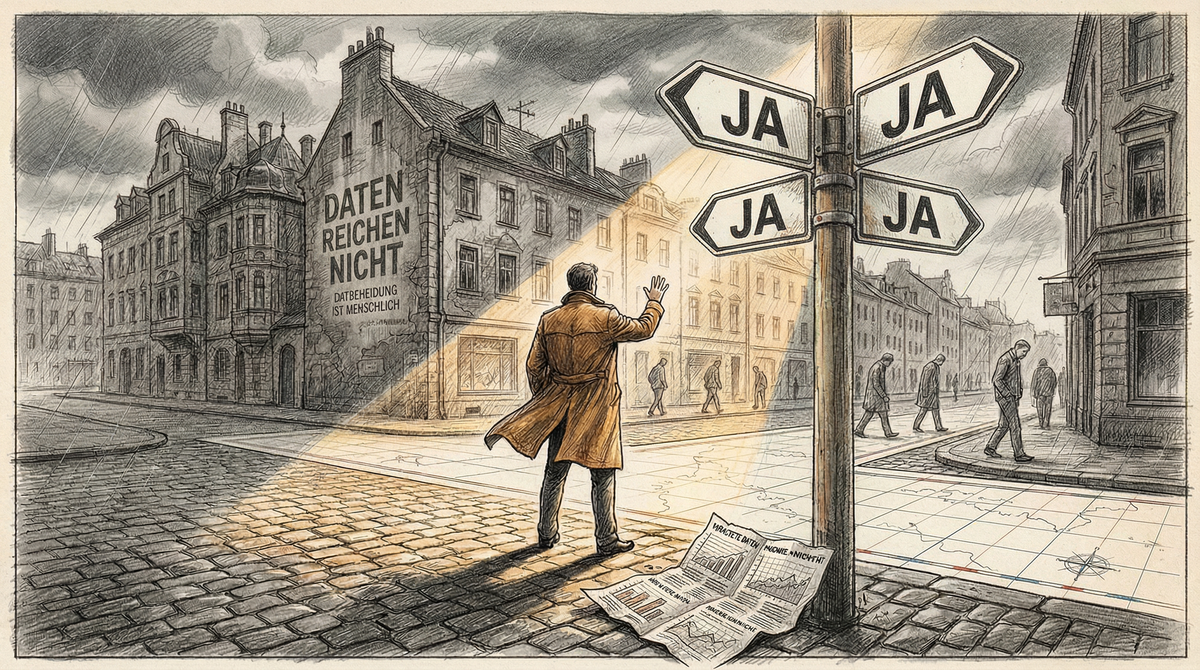

Jetzt kommt die KI. Sie liefert noch mehr Daten, noch bessere Analysen, noch präzisere Prognosen. Und das verschärft das eigentliche Problem. Es versteckt es nur besser.

Was Entscheiden wirklich ist

Hannah Arendt hat eine Unterscheidung gemacht, die nicht viele verstehen. Sie trennt Arbeiten — also Zwangsläufiges — von Herstellen — also Geplantes — von Handeln. Das dritte allein ist frei. Das dritte allein trägt Verantwortung.

Ein Tischler weiß, wie der Tisch aussieht, bevor er ihn baut. Die Pläne sind fertig. Der Weg ist klar. Kein Mut nötig. Das ist Herstellen.

Aber eine Führungskraft — ein Product Owner, ein CEO, jemand der entscheidet — der weiß es nicht. Der kann es nicht wissen. Weil die Zukunft offen ist. Weil Menschen unberechenbar sind. Weil die Welt sich umdreht, während man plant. Das ist Arendts Handeln. Das ist Freiheit. Das ist auch Terror.

Deswegen füllen Organisationen die Angst mit Prozessen. Mit Abstimmungsrunden. Mit Priorisierungs-Frameworks. Mit «Alignment». Mit «Stakeholder Management». Mit allem, nur nicht mit Entscheidung. Sie möchten die Ungewissheit verschwinden lassen. Das geht nicht.

Der Product Owner und seine Tragödie

Der Product Owner ist die tragische Figur in diesem Drama. Ihm sagt man: «Du bist verantwortlich.» Aber Budget-Kompetenz hat er nicht. Die Entwickler kann er nicht feuern. Die Stakeholder nicht zuweisen. Die Gewinne nicht verteilen. Er hat Verantwortung ohne Befugnis. Und das zehrt. Das zehrt schrecklich.

Deswegen geben manche POs auf. Sie werden zu Zeichenempfängern. Sie schreiben auf, was die Kunden sagen. Sie liefern Features ab. Sie geben nach. Und alle sind unzufrieden.

Clayton Christensen hat das untersucht: Die meisten Unternehmen scheitern nicht, weil sie ihre Kunden nicht verstehen. Sie scheitern, weil sie zu sehr ihnen gehorchen. Der Kunde sagt «Ich will größer, schneller, billiger» und die Unternehmen folgen — direkt ins Grab hinein.

Ein guter PO arbeitet manchmal gegen die Stimme des Kunden. Nicht aus Arroganz oder Undankbarkeit, sondern aus einer gesunden Dosis Selbstvertrauen. Und aus der Bereitschaft, zu entscheiden. Das unterscheidet ihn von einem Feature-Manager. Das ist die schwerste Arbeit, die es gibt.

Was KI hier nicht kann

Jetzt kommt die KI und sagt: «Ich kann euch helfen.» Sie berechnet, welche Features den höchsten ROI bringen. Sie sagt, welche Nutzersegmente am wertvollsten sind. Sie modelliert Szenarien. Sie gibt euch noch mehr Information. Und sie löst nicht das Problem. Sie verstärkt es.

Denn die Entscheidungsangst sitzt nicht in den Daten. Sie sitzt in Menschen. Sie sitzt in der Angst, falsch zu liegen. In der Angst, Macht zu zeigen. In der Angst, dass jemand böse wird. Das kann die KI nicht sehen. Das kann sie nicht lösen. Sie kann nur mehr Daten liefern und damit die Illusion aufrechterhalten, dass Information genug ist.

Bonnie Honig hat beobachtet, dass wir in einem Notfall-Normalzustand leben — die Welt ist nicht sicherbar, wir können nicht alle Variablen kontrollieren, die Zukunft ist offen. Das ist kein Design-Fehler. Das ist die Bedingung von Freiheit. Und wer auf vollständige Information wartet, wartet für immer.

Der Mut, der bleibt

Die meisten Reden über KI handeln von dem, was Maschinen können. Sie können rechnen, Muster erkennen, skalieren, optimieren. Das ist das, was Arendt Herstellen nennt — und da werden sie besser sein als Menschen. Das ist unvermeidlich.

Aber Handeln — das Treffen einer Entscheidung trotz Ungewissheit, die Übernahme von Verantwortung für etwas, das schiefgehen kann — das kann die KI nicht. Das ist ein Privileg. Und ein Fluch.

Byung-Chul Han hat beobachtet, dass die moderne Gesellschaft sich durch Selbstausbeutung zerstört. Nicht Fremdausbeutung wie im Industrialismus, sondern Selbstausbeutung — weil sie mit dem Gefühl der Freiheit einhergeht. Jeder arbeitet sich selbst kaputt, und hält sich dabei für frei.

Entscheidungsangst ist Selbstausbeutung. Man vermeidet es, zu entscheiden. Man arbeitet noch mehr an der Informationsbeschaffung. Man macht sich selbst müde mit Abstimmungsrunden. Und nennt es Alignment. Das ist es nicht. Das ist Angst. Und die wird durch KI nicht kleiner. Sondern größer.

Was übrigbleibt

Wenn die KI entscheidet — oder wenn die Menschen entscheiden, indem sie der KI folgen — dann verschwindet das, was Arendt Natalität nennt. Die Fähigkeit, Neues anzufangen. Die Fähigkeit, Initiative zu ergreifen. Die Fähigkeit, eine andere Geschichte zu erzählen.

Für wen entscheidest du? Für wen sagst du Nein? Das sind die Fragen, die bleiben. Wenn die Daten alle sagen «Ja», dann ist die Fähigkeit zu sagen «Nein» das wertvollste, was du hast. Sie ist nicht rational. Sie ist nicht optimiert. Sie ist nicht skalierbar. Sie ist menschlich.

Die meisten Organisationen werden KI einführen. Sie werden damit mehr Daten haben. Sie werden damit noch langsamer entscheiden. Und die besten POs, die besten CEOs, die besten Führungskräfte — die werden diejenigen sein, die den Mut haben, gegen die Daten zu entscheiden. Nicht trotz der KI, sondern weil sie verstehen, dass Entscheidung nicht mit Berechnung zu tun hat. Sie hat mit Verantwortung zu tun.

Das ist das Einzige, das nicht skaliert. Das Einzige, das nicht optimiert werden kann. Das Einzige, das ewig bleibt.

Die Frage ist nicht: Kann die KI besser entscheiden als der Mensch? Die Frage ist: Haben wir noch den Mut, es zu versuchen?

Quellen

- Arendt, Hannah (1958): Vita activa oder Vom tätigen Leben. München: Piper.

- Christensen, Clayton M. (1997): The Innovator’s Dilemma. When New Technologies Cause Great Firms to Fail. Boston: Harvard Business School Press.

- Gloger, Boris (2008): Prioritäten | Priorities | Product Owners Tools. Blogpost, 9. August 2008. borisgloger.com.

- Han, Byung-Chul (2010): Müdigkeitsgesellschaft. Berlin: Matthes & Seitz.

- Honig, Bonnie (2009): Emergency Politics. Paradox, Law, Democracy. Princeton: Princeton University Press.

- Sutherland, Jeff & Sutherland, J.J. (2014): Scrum. The Art of Doing Twice the Work in Half the Time. New York: Crown Business.